《TO》導讀:Google 圖搜功能大進化,未來將可以精確描述出圖片的內容。

這是說以後宮保雞丁的圖片下面會有一行字告訴我:這是一道中式料理,雞肉+花生+辣椒嗎?(有點餓了…)

看著上面的圖片人類可以很容易的描述出「這是一個正在騎摩托車的人」、「三條狗在草地上奔跑」,但如果想讓電腦「看」完圖片之後能自動給出一段這樣的概述就不是一件容易事了,而現在 Google 卻已經做到了。

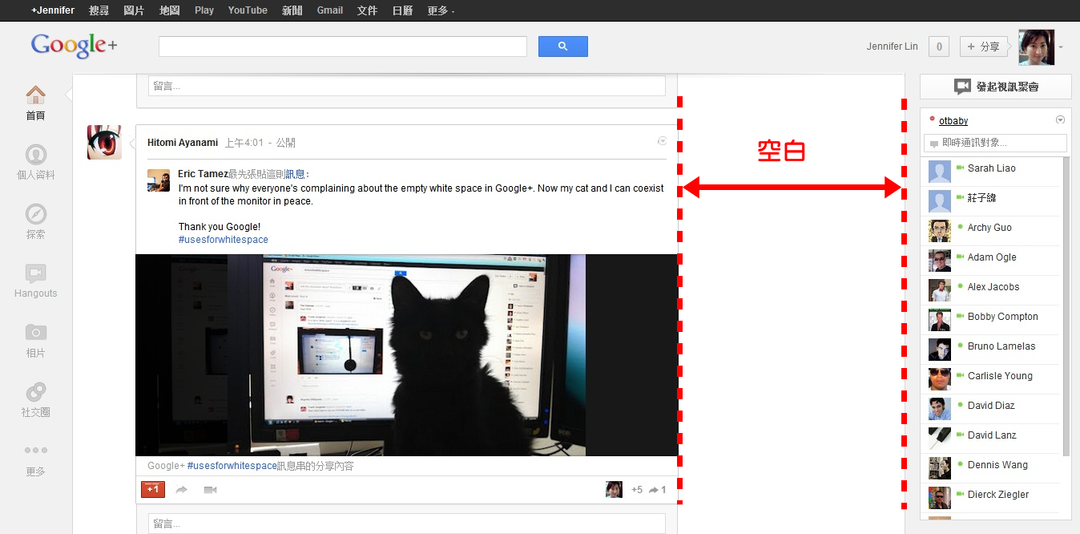

按照 Google 的說法,通過自行開發的機器學習系統,它們現在已經可以用自動化的方式來為圖片添加自然語言描述。這項技術不但有望讓那些對顏色不敏感的人群可以快速理解圖片中的內容,也可以在網絡狀況不好的情況下用文本來暫時替代圖片顯示;當然,更重要的是它還可以讓 Google 的圖片搜索功能更強大。

在以前,業界在用計算機對圖片進行自然語言描述時基本使用的都是計算機視覺和自然語言處理技術;但現在得益於機器翻譯技術的進步,通過遞歸神經網絡(RNN)轉換,機器可以先把法語轉換成一個矢量,接著另外一個 RNN 用戶就可以通過這個矢量把法語轉換成德語;這樣 Google 只要能用另外一種具備圖片識別能力的神經網絡(卷積神經網絡,CNN)替換掉第一個 RNN 就可以得到一句能描述圖片的自然語言了。

所以整個自然語言的生成過程就是由讀取視覺的神經網絡 CNN 到產生語言的神經網絡 RNN,進而最終得到一句自然語言。Google 方面的測試顯示,這項技術的整體效果表現還不錯。當然,我們從第一張圖中也可以看到這其中是會出現一些小錯誤甚至完全不准確的情況,不過隨著數據集的增加和成熟,整體的精確度會越來越高。

其實,早在今年 6 月份時,Google 就發過一篇 blog 闡述它們是如何讓用戶可以根據圖片中的內容來搜索;在 9 月份時,Google 又更新了它們在圖像中物體識別、分類和標記方面的進展。如今到了 11 月,Google 在這方面的技術又有了新的突破。不難看出,最終機器將會更了解圖片,而人們也會更容易找到自己想要的圖片。

(本文轉載自合作夥伴《PingWest》;未經授權,不得轉載)